Künstliche Intelligenz LGBTI*-Organisationen schlagen Alarm und fordern ein Umdenken in der EU

Gedankenspiele rund um die künstliche Intelligenz (KI) faszinieren seit Jahren Schriftsteller und Drehbuchautoren und animieren zu spannenden Antworten auf die Frage, wie unsere Welt in der Zukunft aussehen könnte – zumeist fällt der Blick ins Morgen nicht direkt positiv aus. Dabei bedroht uns die KI mancherorts bereits heute – auch und gerade die LGBTI*-Community. Die LGBTI*-Organisation All-Out schlägt deswegen zusammen mit weiteren queeren Gruppen jetzt Alarm.

Eine KI für zwei Geschlechter

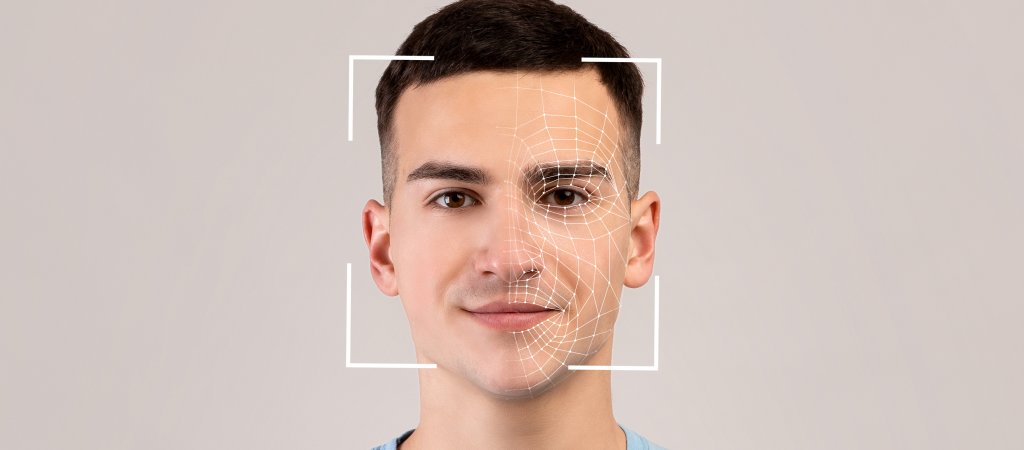

Der Hintergrund: Immer mehr Regierungen und Unternehmen benutzen künstliche Intelligenz, um Menschen zu identifizieren oder ihre Standorte und Gewohnheiten zu verfolgen. Schnelleres Einchecken am Flughafen mit automatischer Gesichtserkennung oder ein personalisiertes Shopping-Erlebnis sind nur zwei der angepriesenen Vorteile. Das Problem aus Sicht der Organisationen: Algorithmen und KI-Erkennungsmarker unterteilen Menschen nebst anderen Merkmalen auch nach ihren zwei biologischen Geschlechtern.

„Die Folgen für die Menschen, deren Geschlecht nicht dem entspricht, dem sie bei ihrer Geburt zugeordnet wurden, können verheerend sein. Denn die verwendeten Algorithmen basieren auf veralteten und gefährlichen Stereotypen über Herkunft und Geschlecht, die uns allen schaden. Diese Art der Technologie beruht auf der Annahme, dass Geschlecht und sexuelle Orientierung mithilfe von Aussehen, Stimme, bestimmten Bewegungen oder einem Namen identifiziert werden können. Dies ist nicht nur fehlerhaft, sondern auch diskriminierend“, so All-Out.

Probleme in Ländern mit Anti-LGBTI*-Gesetzen

Die LGBTI*-Organisation zählt auch konkrete Beispiele auf, in denen es Probleme geben könnte, beispielsweise bei der Security am Flughafen, wenn Gesichtsscanner eine Person aufgrund ihrer Physionomie einem Geschlecht zuordnen, der Reisepass aber aufgrund einer Geschlechtsanpassung das andere Geschlecht ausweist. Ähnlich Fälle könnten laut All-Out auch beim Einsatz von Körper- oder Gesichtserkennungs-KIs in anderen Bereichen geschehen.

„Werden wir jetzt nichts unternehmen, könnte dies bald schon die Realität für viele Menschen auf der ganzen Welt sein. Und in Ländern mit Anti-LGBT*-Gesetzen stellen solche Technologien eine große Gefahr für die Sicherheit von LGBT*-Menschen dar.“ Möglich wäre so beispielsweise auch, dass eine KI mit Hilfe von Algorithmen und den individuellen Merkmalen und Bewegungen eines Menschen mit hoher Wahrscheinlichkeit herausfiltern kann, wer zum Beispiel auf einem belebten Marktplatz homosexuell ist und wer nicht.

Verbot von diskriminierenden Tools

All-Out spricht in seinem offiziellen Statement von „gefährlichen Technologien“. Auch Organisationen wie zuletzt Amnesty International forderten in diesem Zusammenhang die EU-Kommission auf, beim dafür einberufenden Digitalausschuss zur Künstlichen Intelligenz menschliche Risiken stärker zu berücksichtigen. So bestehe auch eine Gefahr in anderen Bereichen jenseits der LGBTI*-Community, beispielsweise wenn es um das Thema Herkunft oder Rasse gehe. Die EU arbeitet seit 2021 an Richtlinien, die künftig für KI-Systeme gelten sollen.

„Dies ist eine einmalige Gelegenheit die automatische Erkennung von Geschlecht und sexueller Orientierung in der EU zu verbieten und auch den Export solcher Tools in andere Teile der Welt zu verhindern.“ Der Europäische Datenschutzausschuss hat bereits im Juni 2021 eine erste Stellungnahme zu dem von der Europäischen Kommission vorgeschlagenen Gesetzesentwurf über künstliche Intelligenz veröffentlicht. Er fordert "ein generelles Verbot des Einsatzes von KI zur automatischen Erkennung menschlicher Merkmale in öffentlich zugänglichen Räumen". Ein Entschluss seitens der EU selbst steht allerdings noch immer aus.